相關文章

詳細介紹

| 品牌 | 其他品牌 | 產地 | 國產 |

|---|

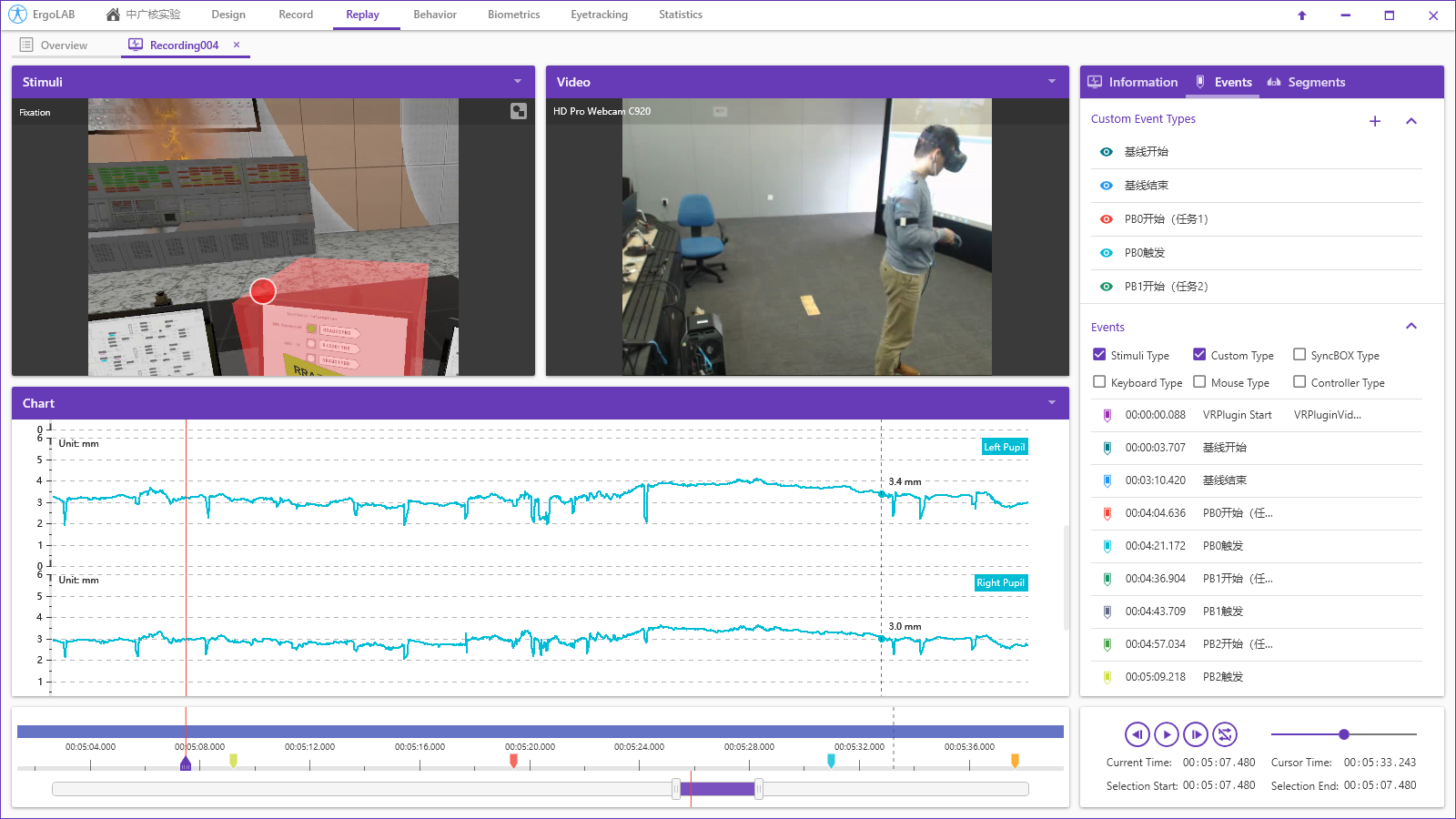

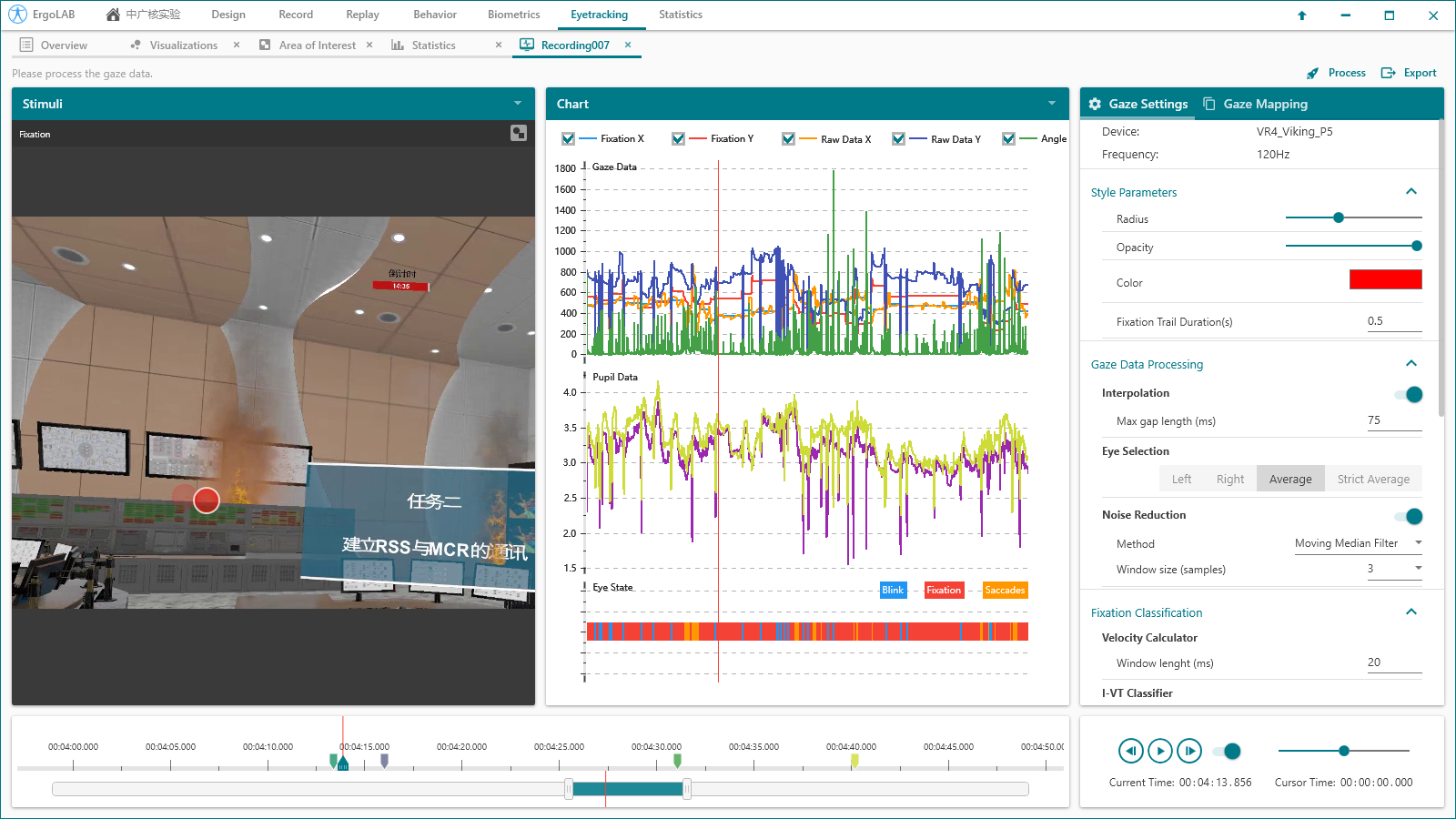

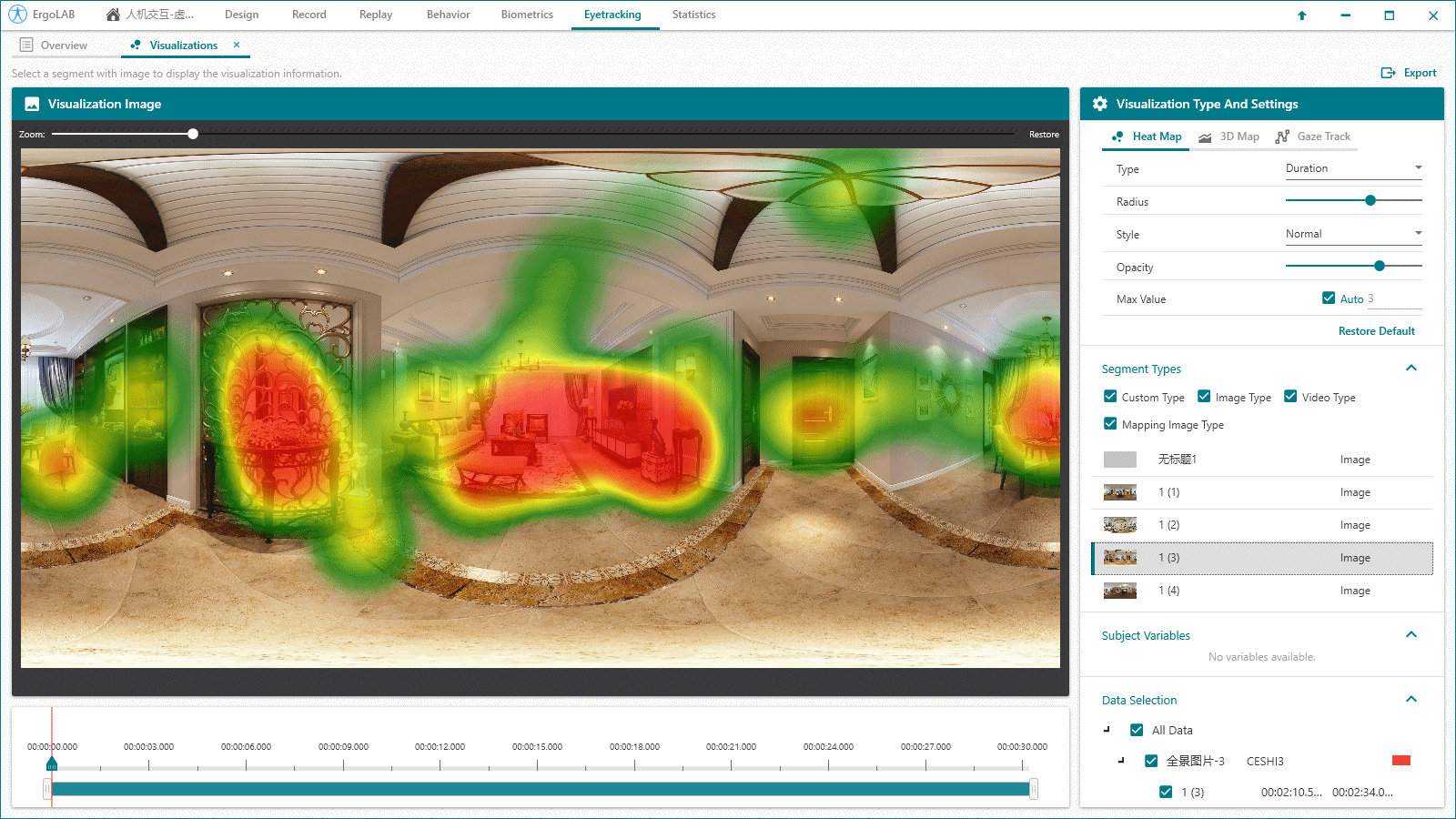

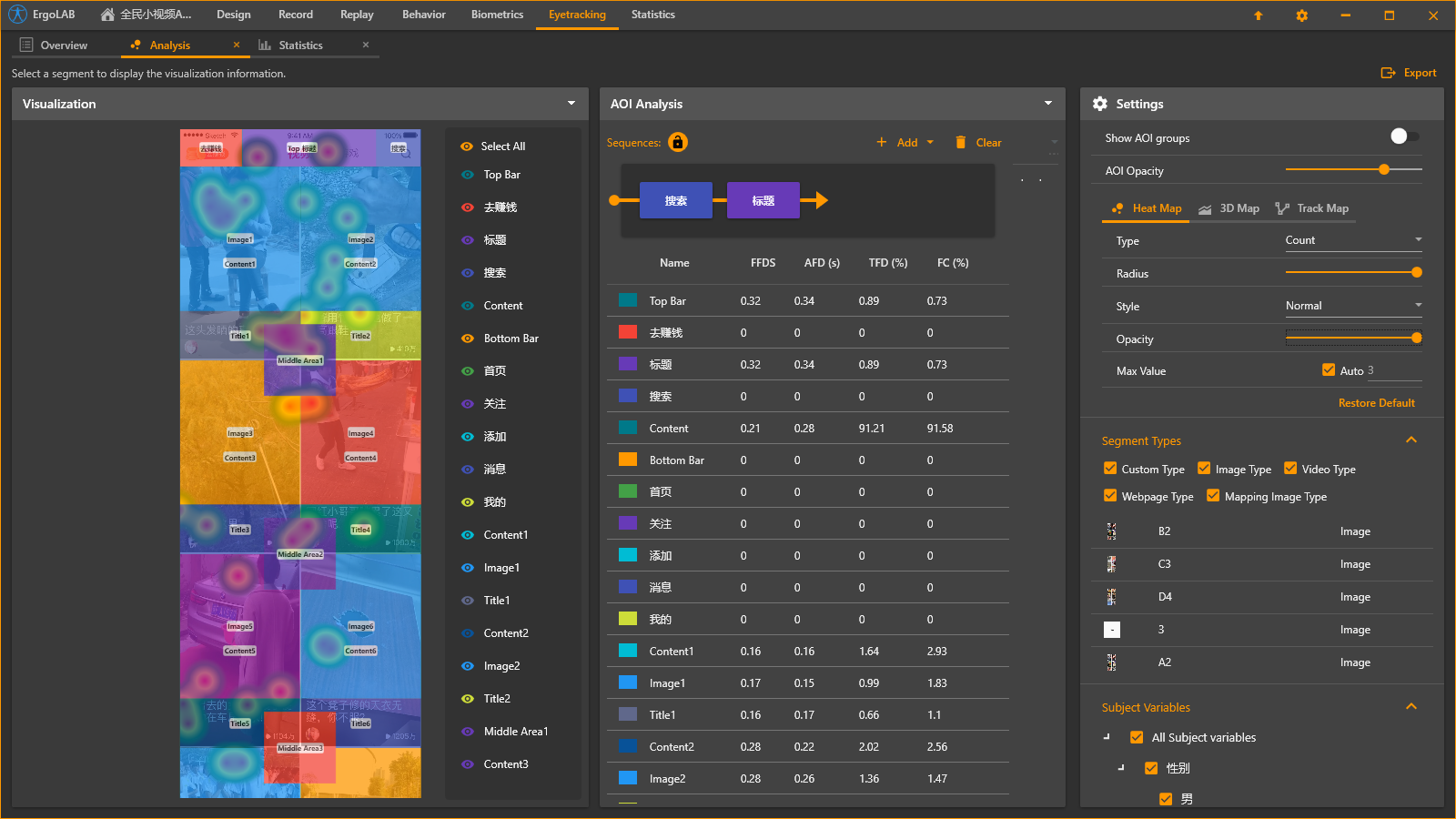

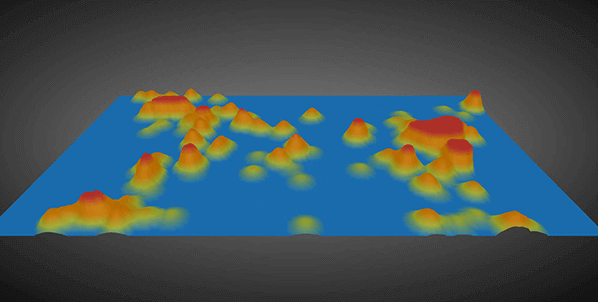

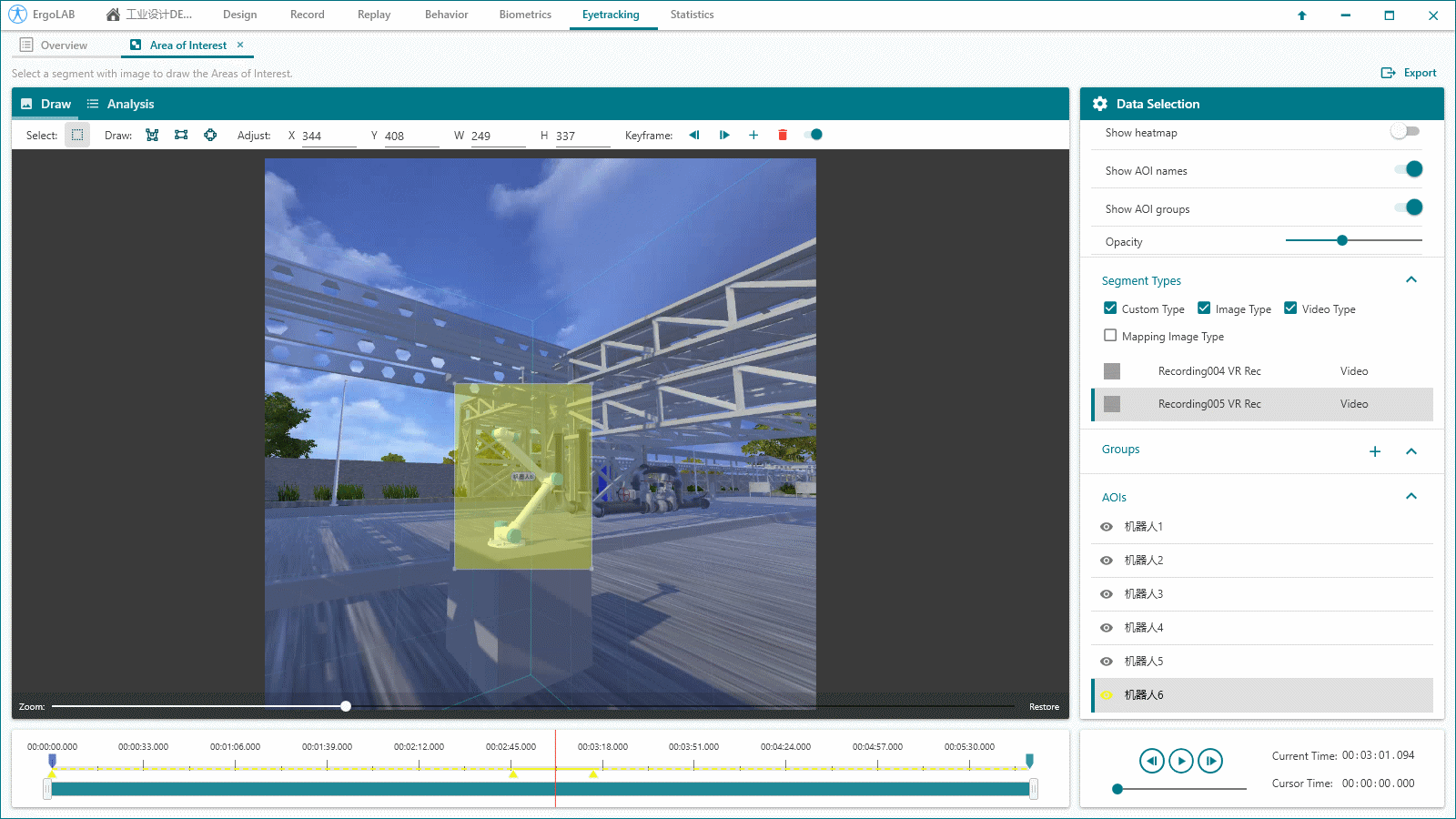

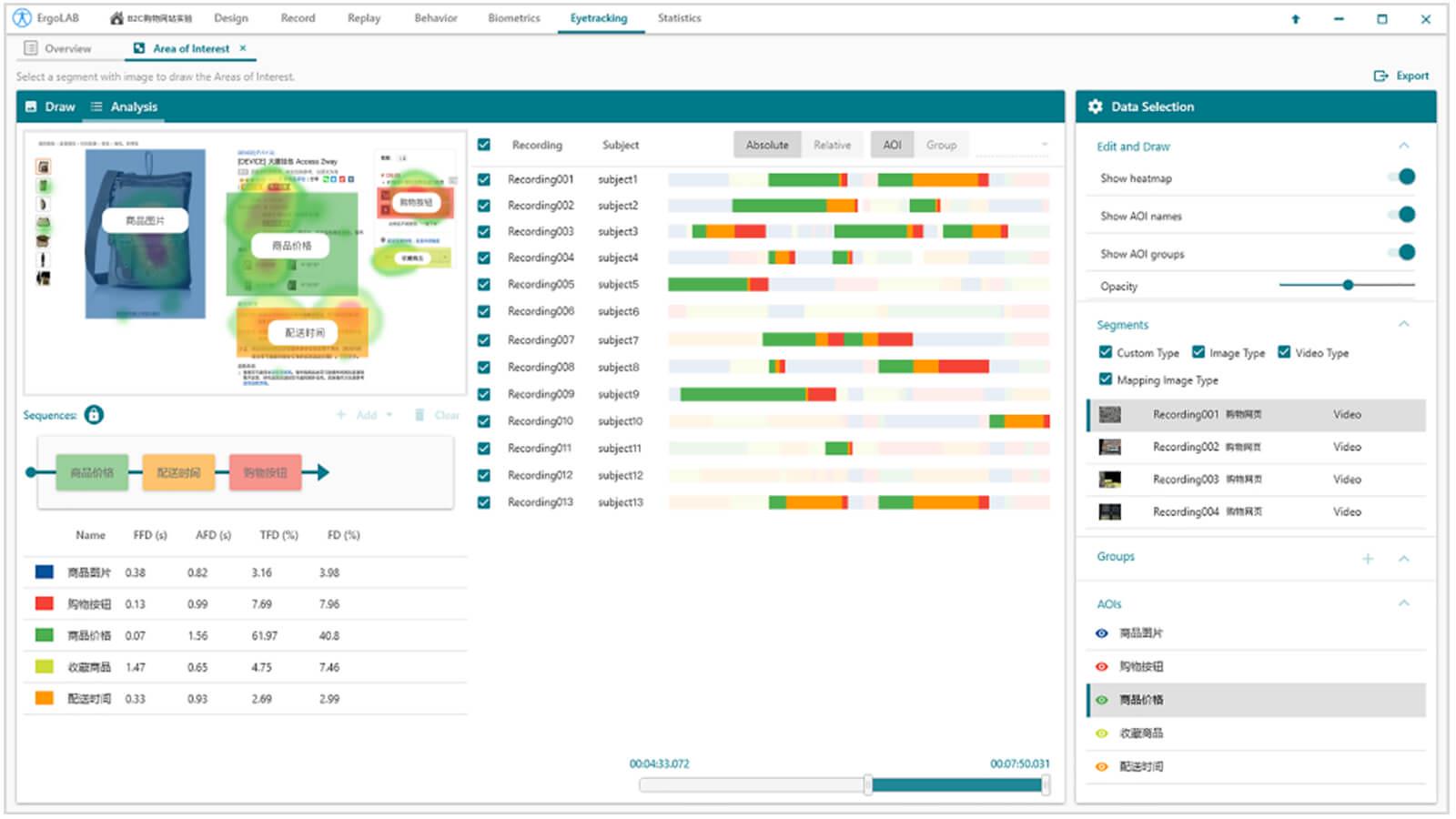

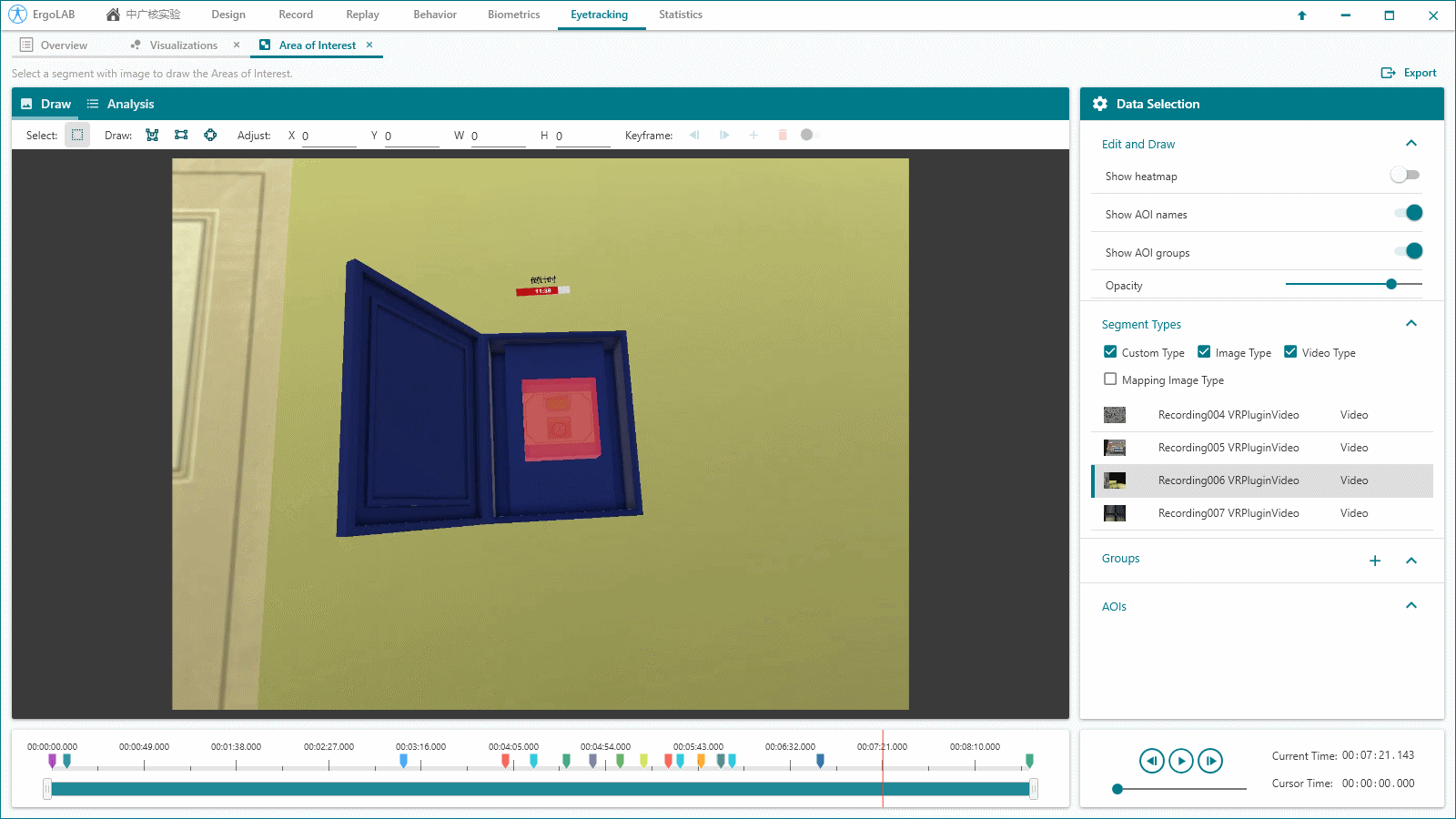

ErgoLAB Eyetracking眼動追蹤模塊,通過紅外光反射原理測量眼睛運動過程,采用高精度的眼動追蹤元件同步記錄個體的眼動軌跡、視線變化、眼動狀態、頭部姿態等數據,進而分析視覺加工特征,了解人們感知其周圍事物的視覺方式以及驅使人們作出決策的因素,在多種視覺刺激和環境下開展人類行為研究。

ErgoLAB人機環境同步平臺采用多模態數據時鐘同步技術,平臺可完成完整的實驗和測評流程,包括項目管理-試驗設計-同步采集-信號處理-數據分析-人因智能評估-可視化報告,支持基于云架構技術的團體測試和大數據管理。

ErgoLAB人機環境同步平臺采用主客觀結合多模態數據同步采集與多維度驗證的方法,數據實時同步種類包含大腦認知數據(EEG/BCI腦電儀與腦機接口邊緣計算設備、fNIRS/BCI近紅外腦成像儀),視覺數據(Eyetracker眼動儀與視線交互系統),生理數據(生理儀含:GSR/EDA、EMG、ECG、EOG、HRV、RESP、TEMP/SKT、PPG、SpO2),行為觀察、肢體動作與面部表情(基本情緒、情緒效價、微表情等)數據、生物力學數據(拉力、握力、捏力、壓力…),人機交互數據(包含人機界面交互行為數據以及對應的鍵盤操作,鼠標點擊、懸浮、劃入劃出等;移動終端人機交互行為數據以及對應的手指軌跡操作行為如點擊、縮放、滑動等;VR終端界面人機交互行為數據及對應的雙手操作拾取、丟棄、控制,VR空間行走軌跡)、以及多類型時空行為軌跡數據采集(包括室內、戶外、以及VR環境不同時空的行走軌跡、行車軌跡、訪問狀態以及視線交互、情感反應、交互操作行為等數據實時同步采集)、以及作業空間及作業環境數據(溫度、濕度、噪音、光照、大氣壓、濕度、粉塵等)等客觀量化數據;為科學研究及應用提供完整的數據指標。

將人工智能技術引入人因工程研究工具,人因工程行業更加深度,使得實驗環境不會受限于某一種設備或數據指標,采集分析不同典型行業或學科專業的人-機-環境系統交互過程中自然狀態下的人類行為數據,獲取更接近真實人員狀態的數據。平臺還提供覆蓋科研實驗全流程的功能模塊,包括項目管理、實驗設計、同步采集、數據分析、綜合統計和可視化報告,結合ErgoAI人因智能邊緣計算平臺為多模態人機環境研究提供一站式人因工程+人工智能解決方案。以ErgoLAB人機環境同步平臺和ErgoAI人因智能邊緣計算平臺為核心的多模態同步人因智能解決方案大大提高了實驗結果的信效度,同時節省了研究的人力、物力、時間,提高了研究與測評的整體效率。

基于ErgoAI人因智能多元時序算法底座與人因工程人機環境數據庫,構建人員特定狀態的預訓練模型,配合高靈活度的訓練方案管理功能,用戶能夠在統一環境中高效構建和優化模型。 從而實現對人員狀態的精準實時評估與預警,如負荷狀態、應激狀態、疲勞狀態、情景意識和注意能力等。

北京津發科技股份有限公司是專精特新重點小巨人,知識產權優勢企業、高新技術企業、科技型中小企業;旗下包含北京人因智能工程技術研究院和北京人因工程設計院等科技研發機構,并聯合共建了北京市企業技術中心、北京本科高校產學研深度協同育人平臺、蘇州市重點實驗室、湖南省工程實驗室、山東省工程研究中心等多個科技創新平臺。

津發科技承擔和參與了多項國家重點研發計劃、工信部高質量發展專項、國家自然科學基金等課題基金。擔任全國信標委XR擴展現實標準化組副組長單位,工信部元宇宙標準化工作組關鍵技術組聯合組長單位;津發科技創新研發了國產化自主可控的人因工程與人因智能邊緣計算系列信創產品與技術,榮獲多項省部級科學技術獎勵;津發科技主持和參編國際/國家、行業/團體標準20余項、榮獲30余項省部級新技術新產品認證,全球申請磚利超過500項、100余項國際和國家注冊商標、130余項國家軟件著作權;已服務全國高等院校和裝備科技工業科研院所應用示范,并已支撐國內科研學者和科技工作者發表中英文學術論文超過1000篇。

電話

微信掃一掃